Automatización con IA: los riesgos invisibles que estás creando sin darte cuenta (Claude, ChatGPT y agentes inteligentes)

La promesa que todos están comprando

- Aquí empieza el verdadero problema. No en la tecnología… sino en cómo se está integrando.

- “Este cambio ya está siendo analizado por organizaciones como OWASP…”

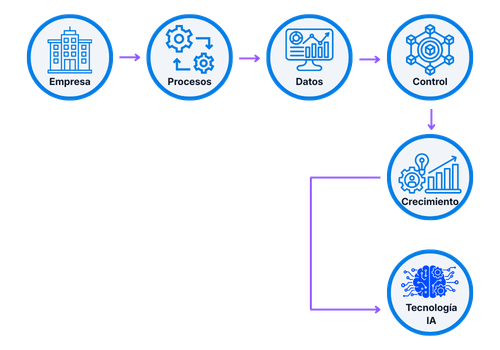

El problema no es la IA. Es cómo la estás integrando

- No estás optimizando un proceso. Estás rediseñando el comportamiento de tu sistema digital.

De herramienta a agente: el cambio que lo rompe todo

- Ese cambio —de herramienta a agente— es uno de los cambios más importantes que estamos viviendo hoy en tecnología.

El nuevo paradigma de seguridad

Los 5 niveles de riesgo que nadie está explicando

Permisos sin comprensión real

Automatización sin supervisión

Ecosistemas conectados

Interpretación sin intención

Superficie de exposición ampliada

El nuevo riesgo: vulnerabilidad por diseño

- Puedes estar en riesgo, si no contralas bien los permisos.

- Basta con acceso mal gestionado.

La pregunta que nadie se hace

La seguridad ya no es técnica. Es arquitectura

Cómo usar IA sin crear un problema

Conclusión: el riesgo no está donde crees

- ¿Qué puede hacer realmente con todo lo que le has permitido?

¿Sustentamos la información?

Casos reales + fuentes (IA + seguridad)

Prompt injection (casos reales investigados)

Qué pasó

ChatGPT plugins / exceso de permisos)

Qué pasó

- acceder a datos sensibles

- ejecutar acciones externas

- ser manipulados indirectamente

No es hackeo: es exceso de permisos + integración

Agentes autónomos (AutoGPT, etc.)

Qué pasó

Sistemas conectados a internet podían:

- ejecutar tareas sin control

- entrar en loops

- tomar decisiones erróneas.

Automatización sin control ≠ eficiencia | Puede generar comportamientos impredecibles

Filtración de datos por uso de IA (casos reales)

Qué pasó

NIST – Framework oficial de riesgo en IA

Qué pasó

- riesgos sistémicos

- riesgos de decisión

- riesgos de automatización

ENISA (Europa) – Amenazas en IA

- manipulación de IA

- uso indebido

- riesgos en automatización